我刚从深圳华强北逛了一圈回来,整个人都有点懵。你猜怎么着?那边做AI服务器生意的老板一个个忙得脚打后脑勺,H20这东西现在是真火。有个做了十几年服务器生意的老哥操着一口浓重的粤语跟我唠:“尼个H20,宜家好难攞货啊,问价嘅人排晒队。”大概意思就是——这玩意儿现在抢手得很,天天有人排着队来问价。他说禁令那会儿手里还有点库存,一台141G显存的H20服务器报价飙到140多万,客户还嫌贵。现在恢复供货了,反倒担心价格会跌,但询价的人比之前翻了不止一倍。

老黄这条“中国特供”算力命脉,经过一整年的禁售、解禁、再禁售、再松绑的折腾,终于在2026年开春重见天日。很多中小企业的老板一边在犹豫要不要上AI,一边眼睁睁看着同行已经把大模型部署上了。今天的文章就是专门给这帮想搞AI服务器却摸不着门路的朋友准备的,咱不聊虚的,直接上干货——国内到底哪些公司真正有资格代理H20?怎么买才不踩坑?

一、英伟达在华代理,其实就那么几家

很多人一听到“代理”二字就头大,总觉得中间商赚差价。但搞算力这事儿还真绕不开他们。据产业链人士透露,英伟达H20芯片的首批备货,主要就是通过浪潮、华硕、新华三这些核心合作伙伴走的渠道-。说白了,官方承认的代理商就那么几根独苗,你想绕过他们直接从英伟达提货?门都没有。

我花了整整一个下午查资料、翻财报、核实互动平台的回复,发现目前A股中实锤的英伟达代理商,满打满算就四家-3。

第一家得说中电港。这公司本身是英伟达中国区官方授权分销商,已经在分销H20芯片及配套方案了。有多猛呢?2025年一季度,它AI服务器相关业务占比直接干到了60%以上,营收同比暴增200%-5。手底下攥着高通、恩智浦、紫光展锐、长江存储等126条国内外授权产品线,渠道成熟得不能再成熟-2。对于想采购H20的企业来说,找中电港是一条比较稳的路子。

第二家是神州数码。这家公司很有意思,是英伟达的代理商,在合规前提下可以开展包括H200在内的各种型号产品的经销-38。有个细节你们细品——它分销及增值服务业务占公司总营收的97.1%,这比例高得吓人,基本上就是靠这吃饭的-2。北向资金连续好几个季度都在加仓,说明机构也看好它在算力分销这块的卡位。

第三家得提杰美特,准确说是它2025年6月并购的思腾合力。这家可是英伟达在中国仅有的11家“精英级合作伙伴”之一,啥概念?国内想拿NVIDIA DGX系列官方授权增值销售资质,不是随便哪个经销商都有资格的-5。思腾合力不光拿下了H100、H800的代理权,连H20的货也早就铺开了,是国内少数能同时拿到这几款芯片代理权的公司-2。

还有一家是先进数通,英伟达是它的合作伙伴,它代理销售英伟达产品-2。主要面向银行业IT基础设施这块,四大行的单子没少做,如果你的项目跟金融、政务这些场景有关,可以重点关注。

至于你问AI服务器H20英伟达代理公司还有哪些,实际上科通技术也是一个绕不开的角色,它是英伟达中国区总代理,同时与全球80多家芯片原厂保持合作,包括英特尔、赛灵思这些巨头-41。三人行这家公司还专门跟科通签了战略合作协议,准备联手搞智算中心,把算力服务做成生意-41。

二、H20服务器到底值不值得买?

这个问题我问了不少行家,得到一个很扎心的结论——别看H20被很多人骂“阉割版”,但性价比还真不赖。

先说价格。2025年4月禁令之前,一台8卡H20(141G显存)服务器市场价大概在120万到130万元之间-27。禁令一来,价格蹭蹭涨,思腾合力的一位销售跟我透露,现货直接飙到140万左右,比年初贵了40万-28。恢复供货后,价格又回落到110万到130万这个区间,单颗H20芯片大约10万元出头-。

为什么大家愿意花这个钱?因为算一笔账你就懂了。运行满血版671B的DeepSeek模型,要达到相似性能,H20用4个节点就够了,国产昇腾910B得用8个节点。光硬件成本这一块,H20的优势至少有1.5倍,业界普遍认为有2到4倍的性价比优势-27。

说白了,你花100多万买H20服务器,跑大模型推理任务的时候,无论是延迟、吞吐量还是能效,在同价位里基本找不到能打的对手。尤其是141GB大显存版本,8卡总显存达到1128GB,原生支持FP8精度的DeepSeek-R1 671B满血版模型,跑千亿参数规模的模型推理毫无压力-28。

对于真正在做AI落地的中小企业来说,采购AI服务器H20英伟达代理公司的货,反而比自己瞎折腾划算得多。

三、想买H20服务器,到底该找谁?

很多老板一上来就说:“我直接找英伟达不行吗?”还真不行。英伟达在中国大陆不直接对终端用户销售整机服务器,它只卖芯片给授权分销商和服务器ODM/OEM厂商。所以你想拿货,要么通过代理商买芯片自己攒机器,要么直接找服务器厂商买整机。

大厂的玩法跟小公司不一样。字节、阿里、腾讯这些互联网巨头,都是直接跟芯片厂商和元器件厂商谈采购成本,一批就是几千台-。小企业怎么办?老老实实找代理商。

目前市面上拿货的主要渠道有几类:第一类是授权分销商,比如中电港、科通技术,他们手里有正规渠道的芯片货源;第二类是服务器系统集成商,比如浪潮信息、工业富联、英业达这些,他们直接从英伟达拿芯片做成整机服务器再卖给你-;第三类是下游经销商,比如新华三这些品牌商,他们会适配H20芯片然后推出整机方案-。

有个建议给你:如果你的技术团队足够强,建议直接找中电港这类分销商买芯片自己组装,成本能省不少。如果图省事、追求交付速度,那就找浪潮或者新华三买整机,人家帮你把兼容性验证、散热方案、软件适配全搞定了。

还有一招——租赁算力。很多经销商在禁令期间囤了不少H20服务器,现在解禁后货多了,他们担心价格往下掉,愿意低价出租算力。据蓝鲸财经报道,有些经销商手上甚至有现货服务器等着交付,你完全可以先租后买,先验证一下效果再说-11。

四、供货稳定吗?会不会又被禁?

这个问题我得说句实话——谁都不敢打包票。过去一年,围绕对华销售先进AI芯片的问题,英伟达在政策与市场之间反复折腾。2025年4月美国商务部一度叫停H20出口,8月又改变决定允许有限恢复。在需求不确定性下,英伟达于2025年8月底暂停了H20的生产-45。

好消息是,2026年初黄仁勋在GTC大会上放话:公司正重启面向中国客户的H200人工智能加速器生产,中国市场订单明显增强-45。另外,美国允许英伟达向中国销售性能较最新产品落后一代的H200处理器,但有个条件——公司需将相关销售收入的25%上缴美国政府-45。

我个人的判断是:短期内断供的风险不大,但长期看国产替代的趋势不可逆。所以现在买H20服务器,建议别搞太大、别囤太多,够用就行,留点灵活度应对政策变化。

写在最后

啰啰嗦嗦写了这么多,其实核心就一句话:AI算力现在是稀缺资源,早入场的企业已经尝到甜头了。H20这条线,代理公司的名单就这几家,认准了就别犹豫。价格在110万到140万之间浮动,性价比在目前中国市场合法能买到的AI芯片里,依然是第一梯队。

如果有条件,建议先去搞一台测试机跑跑你的业务模型,心里有个数再决定买几台。别听网上那些键盘侠瞎喷,说什么“阉割版”“智商税”——真金白银干出来的效率和收益,才是硬道理。

💬 网友问答时间

网友“代码写的比我命还长”问:我们公司是搞医疗AI的,想买两台H20服务器做模型微调和推理,但预算只有150万,够不够?有没有什么省钱的小技巧?

答:这个问题问得太实在了,很多中小企业都卡在预算这关。150万买两台8卡H20服务器,说实话有点紧——目前市场上一台8卡H20(141G显存)整机价格在110万到130万之间,两台的话至少220万起跳-。但别灰心,我有三个省钱的思路供你参考:

第一,不要买整机,自己攒。找中电港这类分销商买H20芯片,单颗10万左右,然后自己配主板、散热、电源、机箱。整机里最大的溢价就是品牌溢价和集成服务费,如果你公司的技术团队有服务器运维经验,自己攒能省30%左右。

第二,先租后买,或者长期租赁。很多经销商手上有H20服务器现货,愿意按月出租算力。你先把模型跑起来,验证一下效果和算力需求,确定需要几台之后再买。有个客户就是这么干的,租了三个月花了不到15万,最终发现只用一台服务器就够了,直接省了一百多万。

第三,别盲目追求141G显存版本。96GB版本的H20虽然停产了,但市面上还有少量存货,价格便宜不少。如果你的模型参数量没到千亿级别,96GB完全够用,跑个几十亿参数的模型绰绰有余。医疗AI领域常见的影像识别、辅助诊断模型,其实不需要那么大的显存。

最后提个醒:电源一定要留余量!一台8卡H20服务器的峰值功耗在3000W左右,千万别图便宜买个杂牌电源,到时候服务器动不动掉电重启,比什么都糟心-30。

网友“一个做实体工厂的老板”问:我是搞传统制造业的,对AI一窍不通。看到同行都说上了AI以后良品率提升了,我也想试试,但怕被代理公司坑。H20服务器对制造业有什么用?采购的时候怎么防坑?

答:老板您这个顾虑我特别理解,传统制造业上AI,最怕的就是花冤枉钱。我跟您说几个实在的,不整虚的:

H20服务器对制造业最大的用处就是机器视觉质检和设备预测性维护。说白了,就是用摄像头拍产品照片,AI模型自动判断有没有划痕、缺角、装配不到位——以前靠老师傅肉眼盯,一天下来眼睛都花了,现在一台服务器能同时管十几条生产线。我认识一个做精密铸造的老板,上了H20跑视觉质检以后,不良率从3.2%降到了0.8%,一年光返工费就省了200多万。

防坑指南给您列三条硬的:

第一,查授权。正规的AI服务器H20英伟达代理公司,都会在英伟达官网的合作伙伴名录里有登记。你让他提供授权证书,没有的一律pass。中电港、神州数码、科通技术这几家是官方认证的,靠得住。

第二,别信“超低价” 。如果有人在华强北跟你说“80万拿一台全新的8卡H20”,扭头就走,大概率是翻新矿卡改的,或者显存被换过。正常渠道价就在110万以上,低于这个数的必有猫腻。

第三,先跑测试。别一上来就签采购合同,让代理公司给你一台测试机跑你的业务模型,跑一周看看效果。正规公司都愿意提供测试服务,如果不给测、或者找各种理由推脱,换一家。

您这情况,我建议先买一台试试水,让技术员跑你们工厂的产品照片数据集,验证一下效果再决定要不要上规模。千万别一上来就买三五台,那是大厂干的事。

网友“程序员小王的日常”问:请教一下,H20服务器跟华为昇腾910B比,到底哪个更值得买?我们现在团队在选型,内部吵翻了,急需第三方观点。

答:哈哈,你这个问到了核心矛盾点,我估计评论区很多人也关心这个。我直接说结论:看场景,没有绝对的谁更好。

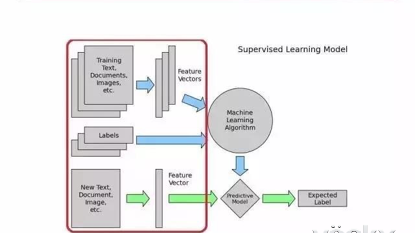

从纯性能角度看,H20跑大模型推理任务确实有优势。前面我提到了,跑671B的DeepSeek满血版,H20用4个节点就行,910B需要8个节点,硬件成本相差1.5倍以上-27。而且H20的软件生态成熟得多,PyTorch、TensorFlow这些主流框架原生支持,开发效率高。

但从政策确定性角度看,昇腾910B是国产的,不怕哪天美国又搞禁令。国内智算中心市场对国产化的要求越来越高,很多地方政府建的算力中心明确要求必须用国产芯片-28。而且910B八卡服务器价格在100万到105万之间,比H20便宜10万到20万-27。

我给您一个决策框架:

如果你的业务是大规模推理、对延迟和吞吐量要求极高、且不涉及政府项目,H20目前性价比更优。

如果你的业务是长期稳定运营、需要政策确定性、或者要接政府/国企项目,昇腾910B是更稳妥的选择。

如果你有预算,混合部署是最好的——关键业务用昇腾保底,高负载推理用H20拉性能,两手都要硬。

我认识好几个AI创业公司都是这么干的:核心模型训练在昇腾上跑,保证不被卡脖子;线上推理服务用H20扛流量,保证用户体验。这样既安全又高效,算下来总成本反而比全压一边更低。

至于你们内部吵翻了的问题,我建议做个A/B测试:找代理商借一台H20测试机,再找华为渠道弄一台910B测试机,跑你们真实的生产数据和业务模型,看哪个效果好就选哪个。数据说话,比谁嗓门大都管用。